Research Projects

Research Projects

The following research projects are currently realized by the HCI group.

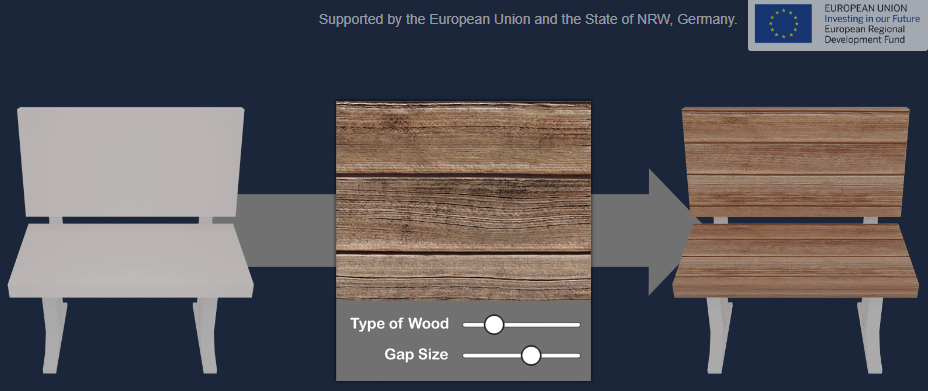

TeKKi

12.2023-12.2024

Texturen sind digitale Materialien, die zur Erstellung von computergenerierten Grafiken unverzichtbar sind. Jede sichtbare Oberfläche einer solchen Grafik, die nicht einfarbig und strukturlos ist, wird durch eine passende Textur erst darstellbar (z.B. Straßenbeläge, Häuserfassaden). Als Konsequenz bilden Texturen die visuelle Grundlage für viele der heutzutage allgegenwärtigen Medien, beispielsweise Videospiele, (Werbe-)Filme, virtuelle Realitäten, aber auch Printmedien. In unserem Fördervorhaben, werden wir konfigurierbare Texturgeneratoren entwickeln, die eine “Texturgenerierung für Kreativschaffende durch Mensch-zentrierte Künstliche Intelligenz” (TeKKI) ermöglichen. Unser Ziel ist es, Texturen für Nutzende selbst intuitiv generierbar zu machen. Durch die geschickte Kombination verschiedener hochspezialisierter KI-Modelle und einer dazugehörigen Nutzendeschnittstelle erlaubt unser Ansatz eine optimale Texturerstellung für Kund:innen nach ihren speziellen Bedürfnissen.

FederleichtLernen

08.2021-07.2024

Die Herausforderungen, mit denen sich Schülerinnen und Schüler (SuS) täglich konfrontiert sehen, sind in den letzten Jahrzehnten stark gestiegen. Die Einführung neuer, komplexerer Lerninhalte steigert dabei die Heterogenität der Lerngeschwindigkeit unter SuS. Desweiteren findet Lernen nicht mehr ausschließlich im Klassenzimmer statt, sondern auch das häusliche Umfeld wird zunehmend relevant. Das Ziel des Verbundprojektes ist die Erforschung und Entwicklung eines Lernsystems für die erweiterte Realität, das direkte Rückmeldung an die SuS ermöglicht und dadurch die Lehrerschaft und Eltern entlastet. Mit Hilfe der erweiterten Realität können Lernmaterialien, die mit Stift und Papier bearbeitet werden, um virtuelle Informationen erweitert werden, die sich räumlich präzise über, zum Beispiel, geschriebenen Text der SuS legen lassen. Zusätzlich zur Lernumgebung soll ein intelligenter Stift entwickelt werden, der über Sensoren relevante Informationen zum Kontext der Lernsituation erfasst (z.B. die kognitive Belastung mittels physischer und physiologischer Parameter). Dabei verfolgt das Projekt einen multidisziplinären, iterativen und nutzerzentrierten Forschungsansatz. Durch die stift-basierte Eingabe in Kombination mit einer einfachen erweiterten Realität, wird eine neue Art von Lernsystem entwickelt, das SuS individuell unterstützt. Zudem wird es ermöglicht, ohne Ablenkung zu lernen und sich auf die eigentlichen Lerninhalte zu fokussieren.

MeSSeR

08.2021-07.2023

In MeSSeR (Mensch-unterstützte Synthese von Simulationsdaten für die Robotik) wird untersucht wie die Mensch-unterstützte Synthese von Simulationsumgebungen zum erfolgreichen Transfer von gelernten Handlungen in die echte Welt beiträgt und wie dieser Ansatz durch den Einsatz erweiterter und virtueller Realitäten (AR/VR) als Ergebnis einer direkten Interaktion eines Menschen mit einer Simulationsumgebung umgesetzt werden kann. Diese Art der Interaktion sichert eine intuitive Interaktion und erleichtert die räumliche Wahrnehmung der simulierten Umgebung und deren Variabilitätsmodell durch den Menschen. Genauer soll in MeSSeR eine Werkzeugkette entworfen, implementiert und evaluiert werden, die das Erstellen einer Simulationsumgebung anhand eines Scans der Umgebung durch den Roboter, das semantische Annotieren bzw. spezifisches visuelles Markup der Simulation durch einen Menschen in AR/VR, die visuelle Verifikation der eingegebenen Variabilität, sowie das Generieren von Daten aus der aus dieser Variabilität zufällig parametrisierten Simulationen zum Maschinellen Lernen von Roboteraktionen in der Umgebung ermöglicht. Die Evaluation erfolgt sowohl anhand industrieller Anwendungen als auch in Haushaltsszenarien.

Eghi

02.2021-10.2024

Das Interesse und eigene Engagement für Gesundheit sind stark gestiegen. Dennoch ist es für viele Menschen schwer, geeignete, gesundheitsfördernde Veränderungen in gewohnten Routinen und Umgebungen selbst zu identifizieren und umzusetzen. Eine Erweiterte Intelligenz bietet das Potenzial eine breite Benutzerbasis bei der Findung ihre eigenen gesunden Verhaltensstrategien zu unterstützen. Ziel des Projekts ist, das Konzept der Erweiterten Intelligenz auf die Unterstützung von gesundem Alltagsverhalten zu übertragen und insbesondere die Ausbildung von persönlichen Verhaltensstrategien (Lösungsfindung) zu unterstützen. Dabei soll durch die sensorgestützte Beobachtung und Modellierung von Situationen und Verhaltensmustern ein gemeinsamer Erfahrungsschatz zwischen Benutzer und KI geschaffen werden, der als Grundlage, quasi gemeinsame Kommunikationsebene, zwischen Mensch und KI dienen kann. Durch eine neuartige, KI-basierte Strategiemodellierung aus vielen Nutzerdaten sollen Erfolgsaussichten von Entscheidungen prognostiziert werden. Ein neues, in individuelle Alltagsabläufe integriertes Interaktionskonzept soll Benutzer bei der Veränderung von Gewohnheiten unterstützen.

IoTAssist

03.2020-02.2023

Grundlegendes Ziel des IoTAssist Projekts ist die Entwicklung einer Plattform, die eine Interoperabilität zwischen Geräten und Diensten im IoT- und Wearable-Bereich ermöglicht. Diese Plattform bietet die Möglichkeit intelligente Assistenzsysteme einfach und intuitiv umzusetzen. Hier legen wir besonderen Fokus auf die Integration schon existierender Geräte-Ökosysteme im alltäglichen und häuslichen Umfeld, um dem wachsenden Problem der Insellösungen entgegenzutreten. Damit die verschiedenen Technologien einfach eingebunden werden können, stellen wir eine technologieneutrale Schnittstelle und verschieden Künstliche Intelligenz Module zur Verfügung. In nutzerzentrierten Workshops werden individuelle, auf den Benutzer zugeschnittene Assistenzsysteme aufgebaut und im täglichen Alltag erprobt.

Scalable Biometrics

10.2020 - 09.2024

The main challenge this project is addressing is the question how behavioral biometric approaches scale to different pervasive computing environments, containing multiple users with changing behavior, different physicalities, and changing sensing and interaction capabilities. While behavioral biometrics so far was mainly investigated in the lab for single users, we envision this project to enable a significant leap forward towards behavioral biometrics becoming a powerful means for identifying and authenticating users in future pervasive computing environments that combines high usability with strong security.

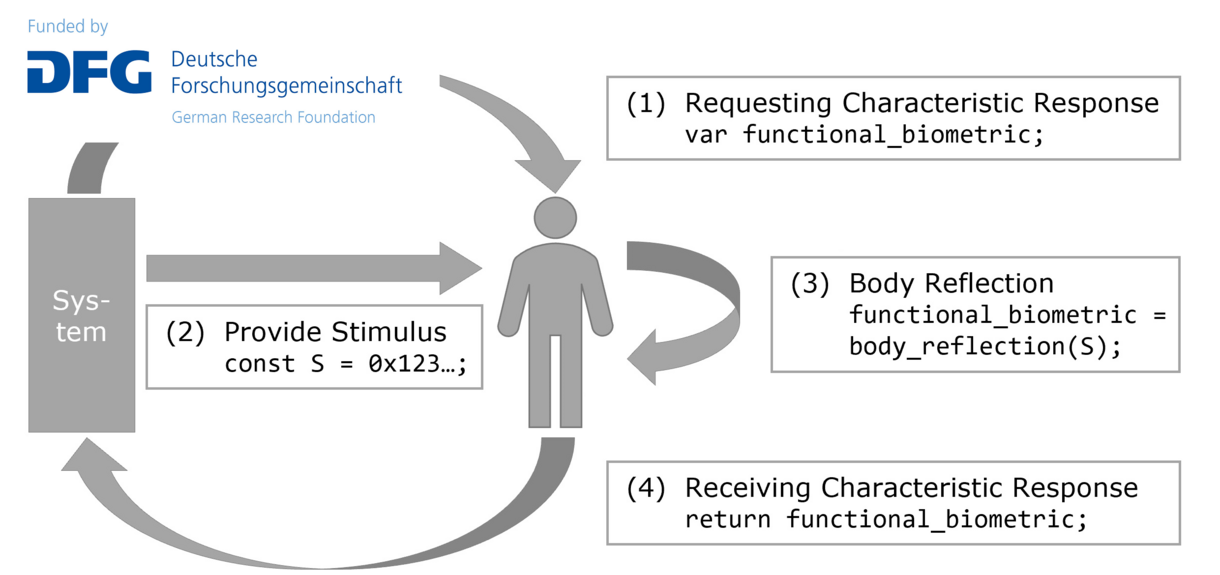

Functional Biometrics

05.2020 - 04.2024

In this project, we introduce a novel class of biometrics, called Functional Biometrics. In contrast to physical token and behavior based biometrics, Functional Biometrics exploit the user´s body as a function. Thus, this novel class of biometrics does not only rely on the body itself but also on a specific input signal generated by the system the user wants to authenticate to. This signal (e.g., audio, electrical, haptic stimulus) is modified by the user´s body which in return generates a characteristic response through a user’s unique body reflection (e.g., propagated audio response, muscle reaction). This characteristic response is used as a biometric password. It is measured by the system and compared to a pre-stored response (i.e., the password) to authenticate the user.

ComIC

01.2018-12.2020

The ComIC (Computing for Intercultural Competence) project promotes the intercultural dialog between Islamic and European countries using “computing” and “research” as the common language to tackle emerging challenges. Intercultural dialog refers to proactive awareness and preparedness to integrate within other societies in social and professional aspects. This is particularly important when considering the IT industries in western and Islamic countries. In western countries, there is a gap between the number of available computing jobs and the number of qualified computing professionals. It is known that there are more computer science related job opportunities than computer science students. On the other hand, there is a misconception in Egypt that there are no jobs for computer science graduates.